Cảnh giác khi cung cấp thông tin cá nhân cho… AI

Vừa qua, tính năng mới tạo ảnh đại diện bằng trí tuệ nhân tạo - Zalo AI Avatar đã tạo nên cơn sốt trên mạng xã hội. Bởi lẽ, những bức ảnh chân dung đẹp, lung linh, siêu thực với nhiều phiên bản, phong cách khác nhau được Zalo AI Avatar tạo ra đã gây bất ngờ thú vị với người dùng.

Tuy nhiên, nhiều người không hề biết rằng việc sử dụng ứng dụng chỉnh sửa ảnh này tiềm ẩn nguy cơ mất an toàn thông tin và đã được các chuyên gia cảnh báo.

Cơn sốt ảnh bằng trí tuệ nhân tạo

Từ khi tính năng tạo ảnh đại diện trí tuệ nhân tạo này ra đời, không chỉ làm các chị em mê mẩn mà ngay cả phái mạnh cũng đua nhau thử “giao diện mới” của mình. Anh Lê Việt Dũng, 25 tuổi (Chung cư Mipec, phường Kiến Hưng, Hà Đông) vui vẻ chia sẻ: “Bản thân tôi trước đó không quan tâm lắm đến mấy cái trò biến hình trên các app vì biết, nếu sử dụng thứ nhất là nguy hiểm, hơn nữa mình là đàn ông ai lại đi đú mấy cái trend vớ vẩn. Nhưng quả thực với cái Zalo AI Avata này nó khiến tôi thấy thú vị và tò mò thực sự. Nó có thể khiến tôi nhìn thấy mình ở nhiều phiên bản khác nhau và nhiều độ tuổi khác nhau. Nhìn ảnh nào cũng thấy cái thần thái của mình trong đó. Thực sự là, với cái app mới lần này của Zalo, không chỉ tôi mà nhiều anh em cùng cơ quan và bạn bè trên Facebook của tôi đều tham gia rất sôi nổi”.

|

|

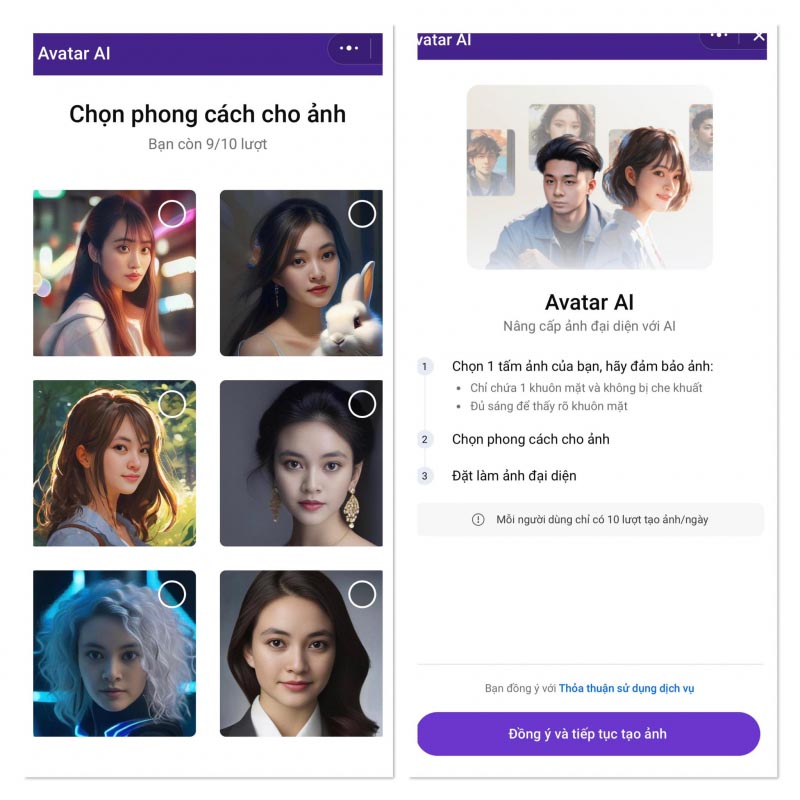

Zalo AI Avatar - một chương trình trí tuệ nhân tạo do người Việt phát triển. |

Riêng về “hội chị em” thì tính năng mới này của Zalo đúng là một món quà bất ngờ và thú vị. Đâu đâu trên Facebook cũng dễ dàng bắt gặp những hình ảnh do AI tạo ra này. Chị Nguyễn Thị Phương Hoa, 32 tuổi (ngõ chợ Khâm Thiên, Đống Đa, Hà Nội) không giấu được sự phấn khích khi nói về những bức ảnh AI của mình và nhiều bạn bè. “Là mình nhưng lại không phải là mình chính là cảm giác khi thử tính năng mới của Zalo. AI bắt được thần thái của mình nhưng lại khiến mình xinh hơn và đa dạng hơn nhiều khiến tôi thực sự thấy thích thú. Vừa biến hình thành nhân vật hoạt hình, rồi lại chuyển qua “nữ tổng tài” hay một hình ảnh yểu điệu thục nữ nào đó. Tóc dài, tóc ngắn, trẻ, già… đều được cả. Hiếm khi mình có thể nhìn thấy mình ở nhiều giao diện đến thế”, chị Hoa phấn khích chia sẻ.

Dù biết tham gia những ứng dụng kiểu này nhiều khi rất nguy hiểm vì có thể khiến thông tin cá nhân bị lộ lọt nhưng chị Bùi Thị Hòa (trú tại ngõ 12 Trần Quý Kiên, Cầu Giấy, Hà Nội) vẫn không thể cưỡng được sự cám dỗ. Chị Hòa nói: “Trước đó vì chủ quan và chưa hiểu biết nên mình cũng tham gia vào một vài trò chơi trên các app. Nhưng giờ nhận ra hậu quả thì cũng muộn rồi, thành ra tâm lý chả có gì để mất nên lại tiếp tục tham gia vào các ứng dụng khác tương tự(!) Với Zalo AI Avata mình cũng không thể đứng ngoài được. Thậm chí, vì thấy thú vị nên mình đã dùng hết ảnh của các thành viên của gia đình để tạo AI Avata cho mọi người. Giờ thấy bảo, có thể những hình ảnh đó có thể bị lấy để phục vụ cho những mục đích xấu mình cũng thấy rất… rén.”

Để có ảnh đại diện mới bằng Zalo AI Avatar, người dùng cần gõ tên ứng dụng vào phần tìm kiếm. App yêu cầu cấp quyền truy cập vào kho ảnh để chọn ảnh rõ mặt hoặc chụp ảnh mới. Sau khi nhập một số thông tin về giới tính, lứa tuổi và phong cách ảnh mong muốn sẽ cho ra kết quả hình chỉnh sửa. Đáng nói, hầu hết người tham gia sử dụng ứng dụng đều đã nhanh tay nhấp vào phần “Đồng ý với Thỏa thuận về dịch vụ Zalo” mà không hề đọc điều khoản. Thực tế, thói quen sử dụng trước khi đọc hướng dẫn là khá phổ biến và điều này mang đến nhiều rắc rối khi có tranh chấp xảy ra giữa người sử dụng và bên cung cấp dịch vụ.

Những ngày qua anh Đinh Văn Hiệp (trú tại An Khánh, Hoài Đức, Hà Nội) cảm thấy “ngộp thở” khi bạn bè thi nhau đổi avatar theo app mới. Vì “đụng” ảnh mới của bạn bè quá nhiều trên Facebook nên anh Hiệp cũng tò mò làm theo. Do tính cẩn thận nên anh thử vào “thỏa thuận sử dụng dịch vụ” của app thì lấy có đến 13 điều khoản dài ngoằng. “Có rất nhiều điều khoản mình đọc không hiểu nên quyết định dừng lại, không thao tác tiếp theo”, anh Hiệp cho biết.

Tiềm ẩn nhiều nguy cơ mất an toàn

Điều mà khiến nhiều người trở nên thích thú với những bức ảnh do Zalo AI tạo ra là vì nó vẫn giữ được những đường nét tự nhiên trên khuôn mặt. Người dùng chỉ cần tải ảnh lên app Zalo AI Avatar, sau đó vào mục đồng ý và tiếp tục tạo ảnh, chọn ảnh trên máy, chọn giới tính, độ tuổi. Phần mềm này sau đó sẽ hướng dẫn người chơi chọn phong cách cho ảnh.

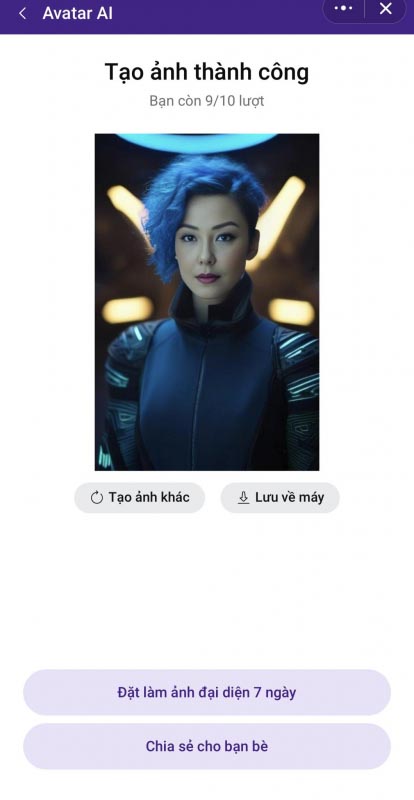

Từ yêu cầu này, AI sẽ xử lý yêu cầu, tạo ra hàng loạt ảnh chân dung mới. Trung bình, mỗi lần chơi, người dùng có thể tạo ra 50 bức chân dung và lưu lại những bức làm mình hài lòng nhất. Con số này cho phép họ thử nghiệm rất nhiều kiểu tạo hình của bản thân ở các độ tuổi khác nhau.

Những trò chơi tưởng như vô hại này gần đây nhiều chuyên gia công nghệ đã khuyến cáo người dùng về nguy cơ lọt dữ liệu cá nhân khi sử dụng các tính năng chỉnh sửa bằng Al được cung cấp trên mạng xã hội. Các chuyên gia cho rằng, ảnh khi chụp bằng điện thoại thường sẽ có thêm thông tin về thời gian, loại điện thoại đang dùng và vị trí chụp bức ảnh. Chính điều này có thể tổng hợp ra thói quen, lịch trình hoạt động, di chuyển của người dùng. Việc cung cấp ảnh chân dung của chính mình cũng tạo nguy cơ bị lợi dụng để tạo ra ảnh giả mạo, video giả mạo nếu chúng lọt vào tay kẻ xấu.

Đại diện của dự án Chống lừa đảo của Việt Nam cho rằng, không phải ai cũng tìm hiểu kỹ điều khoản sử dụng, chính sách bảo mật của dịch vụ. “Người dùng sử dụng ứng dụng cũng đồng nghĩa đồng ý với các điều khoản, trong đó dịch vụ, nền tảng hoàn toàn có thể có những điều khoản gây bất lợi cho họ trong tương lai. Việc tập trung các ảnh tại một nơi sẽ có nguy cơ lộ lọt, tấn công bởi hacker. Nếu kho ảnh rơi vào tay kẻ xấu, chúng có thể dùng Deepfake để tạo ảnh và video giả mạo cho các mục đích khác nhau, thậm chí lừa đảo”, đại diện dự án Chống lừa đảo nói.

|

|

Một bức ảnh được tạo ra bằng trí tuệ nhân tạo - Zalo AI Avatar. |

Qua tìm hiểu, cuộc gọi video Deepfake là công nghệ ứng dụng trí tuệ nhân tạo (Al) để tạo ra các doạn video với hình ảnh khuôn mặt nhân vật giống hệt như hình ảnh người dùng muốn giả mạo. Từ một công nghệ phục vụ giải trí nay những kẻ lừa đảo, tung tin giả đã ứng dụng Deepfake vào các chiêu trò của mình, tạo nên một cách thức lừa đảo mới vô cùng hiểm độc.

Thực tế thời gian vừa qua đã có khá nhiều người từng là nạn nhân của chiêu trò lừa đảo từ cuộc gọi Deepfake. Như trường hợp của chị Lê Thanh Thúy (trú tại Hữu Bằng, Thạch Thất, Hà Nội) cũng là bài học cho nhiều người. Chị Thúy nhận được tin nhắn của anh trai qua Facebook đề nghị chuyển tiền với nội dung: “Tài khoản của em còn đủ 10 triệu không, chuyển cho anh để lo việc, sáng mai anh gửi trả em”. Sau khi nhắn tin, tài khoản này còn gọi video qua Facebook cho chị Thúy với thời lượng 10 giây. Trong video hiện lên hình ảnh anh trai chị Thúy dù hình ảnh video không thực sự rõ nét. Mặc dù có đôi chút băn khoăn vì chưa bao giờ anh trai hỏi vay tiền, song thấy hình ảnh anh mình qua cuộc gọi video nên chị Thúy vẫn quyết định chuyển số tiền anh trai yêu cầu.

Hay như trường hợp của anh Lê Quang Thuận (Tân Yên, Bắc Giang), anh Thuận cũng nhận được tin nhắn qua messenger của em gái hỏi vay 10 triệu để sửa xe ôtô. “Sau khi nhận tin nhắn vay tiền, tôi lại nhận được cuộc gọi video qua Facebook, quả thực là có hình em tôi nói mặc dù hơi mờ. Chính vì thế tôi cũng không nghi ngờ gì, khi hỏi số tài khoản để bắn thì họ lại cho tôi số tài khoản lạ. Để chắc chắn tôi đã gọi điện thoại cho em gái thì mới biết Facebook của em tôi vừa bị hack”.

Nói về vấn đề này, anh Nguyễn Hưng (đồng sáng lập) dự án Chống lừa đảo trên không gian mạng cho hay, hoàn toàn có thể xảy ra việc người chơi bị các đối tượng xấu lợi dụng hình ảnh để lừa đảo. Bởi việc chỉnh sửa ảnh bằng AI đòi hỏi người dùng phải đăng tải hình ảnh gốc của mình lên công cụ làm nguồn để chỉnh sửa. Phía máy chủ của ứng dụng có thể lưu lại hình ảnh này và dẫn đến các nguy cơ như: Lộ lọt thông tin cá nhân. Bởi các hình ảnh khi chụp đôi khi có dính các thông tin định danh như địa chỉ nhà, biển số xe, nơi làm việc, vị trí làm việc... việc thu thập các thông tin này cùng với các thông tin công khai khác sẽ giúp đối tượng xây dựng được chân dung hoàn chỉnh về người dùng và dễ dàng giả mạo họ.

Nguy cơ tiếp theo chính là lộ lọt vị trí địa lý, các thiết bị khi chụp ảnh thường tự động chèn các thông tin liên quan đến thiết bị, vị trí vào tấm hình (được gọi là thông tin Geotag, metadata). Các thông tin này bao gồm: thông tin GPS chính xác (longitude, latitude) giúp xác định vị trí tấm ảnh được chụp, ngày giờ chụp, thiết bị chụp...

“Một trong những nguy cơ nữa chính là việc các đối tượng lừa đảo có thể sử dụng hình ảnh định danh của người chơi cùng các thông tin thu thập được để tạo nên các giấy tờ xác minh giả, vượt qua quá trình xác minh trực tuyến để khôi phục quyền truy cập tài khoản, tạo tài khoản giả mạo, hình ảnh, tin tức giả mạo.... Cùng với sự phát triển của AI, các đối tượng dễ dàng dùng khuôn mặt của người dùng để cắt ghép tạo thành các hình ảnh giả mạo, tạo nên các tin tức giả mạo, bôi nhọ, xuyên tạc, khiêu dâm, lừa đảo”, anh Nguyễn Hưng nói.

Chính những hình ảnh này sẽ là nguồn “huấn luyện” cho AI tạo ra các hình ảnh dựa trên đặc điểm của người dùng. Với công nghệ này, khuôn mặt người dùng có điểm chung với khuôn mặt được tạo bằng AI nên dễ thực hiện cuộc gọi deepfake để lừa đảo người thân.

Anh Hưng cho biết thêm: “Hiện, Microsoft cũng đã có công nghệ bắt chước giọng nói, chỉ cần vài giây giọng nói AI có thể bắt chước và tạo ra giọng nói tương tự người thật. Khi kết hợp với Deepfake sẽ tạo ra một cuộc gọi giả mạo nạn nhân toàn vẹn. Cùng với đó là xây dựng profile giả mạo của nạn nhân. Bởi công nghệ AI hiện tại (stable diffusion) đã cho phép người dùng tạo ra các hình ảnh giả mạo các hoạt động sinh hoạt của người bình thường. Đối tượng có thể tận dụng điều này kết hợp với các thông tin định danh khác để tạo ra 1 profile tương tự như nạn nhân và có các hoạt động sinh hoạt như bình thường. Qua đó, lừa đảo người thân hoặc dùng vào các mục đích xấu”.

|

|

Trung tá Triệu Mạnh Tùng, Phó Cục trưởng Cục An ninh mạng và phòng chống tội phạm sử dụng công nghệ cao phát biểu tại cuộc họp. |

Đại diện Cục An ninh mạng và phòng chống tội phạm sử dụng công nghệ cao cho biết, về thủ đoạn sử dụng công nghệ giả hình ảnh, giọng nói người quen của bị hại nhằm chiếm được lòng tin để vay tiền, chuyển tiền, Cục A05 đã báo cáo lãnh đạo Bộ Công an và đã có điện chỉ đạo đến Công an các đơn vị, địa phương tập trung nắm tình hình, tuyên truyền, phổ biến phương thức thủ đoạn phạm tội này đến đông đảo quần chúng nhân dân.

Trung tá Triệu Mạnh Tùng, Phó cục trưởng Cục A05 thông tin: “Người dân phải thường xuyên cập nhật thêm những thông tin về các phương thức thủ đoạn lừa đảo mới trên các phương tiện truyền thông, phải bảo mật các thông tin liên quan đến tài khoản mạng xã hội, đồng thời phải cảnh giác cao khi người quen tương tác với mình qua mạng xã hội có các yêu cầu giao dịch về mặt tài chính có dấu hiệu bất thường thì cần liên hệ trực tiếp với người đó để tránh thành nạn nhân của các vụ lừa đảo”.

Theo Báo điện tử Đảng Cộng sản Việt Nam